Нов модел на вештачка интелигенција (ВИ) штотуку постигна резултати на човечко ниво на тест дизајниран за мерење на општа интелигенција (general intelligence).

На 20 декември, системот o3 на OpenAI постигна 85% на реперот ARC-AGI, многу над претходниот најдобар резултат за вештачка интелигенција од 55% и на исто ниво со просечниот човечки резултат. Исто така, постигна добри резултати на многу тежок тест по математика.

Создавањето вештачка општа интелигенција (general intelligence) , или AGI, е наведената цел на сите големи истражувачки лаборатории за вештачка интелигенција. На прв поглед, OpenAI се чини дека барем направи значаен чекор кон оваа цел.

Додека скептицизмот останува, многу истражувачи и развивачи на вештачка интелигенција чувствуваат дека нешто штотуку се сменило. За многумина, изгледите за AGI сега изгледаат пореални, итни и поблиски од очекуваното. Дали се во право?

Генерализација и интелигенција

За да разберете што значи резултатот o3, треба да разберете за што е ARC-AGI тестот. Во техничка смисла, тоа е тест за „ефикасноста на примерокот“ на системот за вештачка интелигенција во прилагодувањето на нешто ново – колку примери на нова ситуација треба да види системот за да открие како функционира.

Систем за вештачка интелигенција како ChatGPT (GPT-4) не е многу ефикасен за примерокот. Беше „тренирано“ на милиони примери на човечки текст, конструирајќи веројатни „правила“ за тоа кои комбинации на зборови се најверојатни.

Резултатот е прилично добар во заедничките задачи. Лошо е во невообичаени задачи, бидејќи има помалку податоци (помалку примероци) за тие задачи.

Сè додека системите за вештачка интелигенција не можат да учат од мал број примери и да се прилагодат со поголема ефикасност на примерокот, тие ќе се користат само за многу повторувачки работи и оние каде што повремениот неуспех е толерантен.

Способноста за прецизно решавање на претходно непознати или нови проблеми од ограничени примероци на податоци е позната како капацитет за генерализирање. Нашироко се смета за неопходен, дури и основен елемент на интелигенцијата.

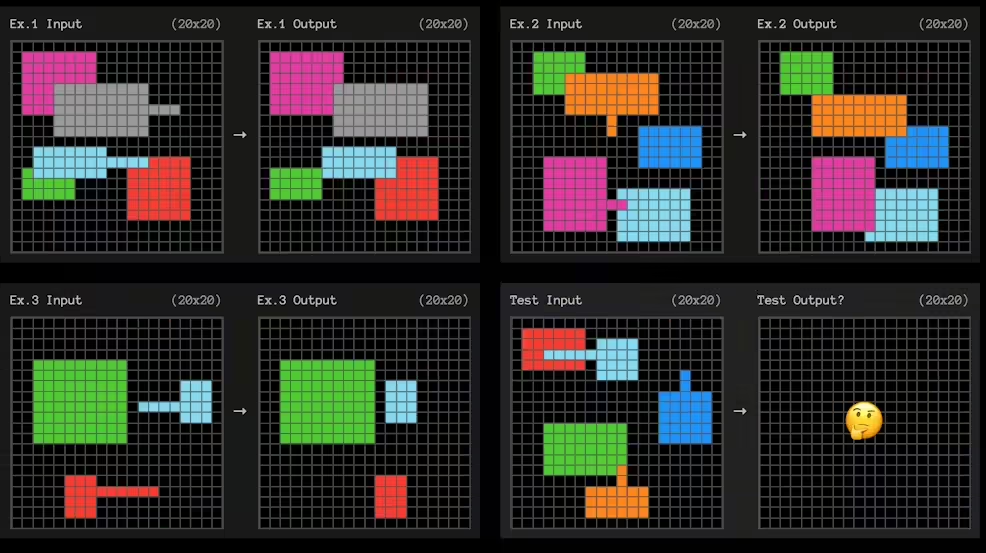

Реперот ARC-AGI тестира за ефикасна адаптација на примерокот со помош на мали квадратни проблеми со мрежа како овој подолу. Вештачката интелигенција треба да ја открие шемата што ја претвора решетката лево во мрежата од десната страна.

Секое прашање дава три примери за учење. Системот за вештачка интелигенција потоа треба да ги открие правилата што ги „генерира“ од трите примери до четвртиот.

Овие се многу слични на тестовите за интелигенција применливи во образованието.

Слаби правила и адаптација

Не знаеме точно како OpenAI го направи тоа, но резултатите сугерираат дека моделот o3 е многу прилагодлив. Од само неколку примери, наоѓа правила што може да се генерализираат.

За да откриеме шема, не треба да правиме никакви непотребни претпоставки или да бидеме поконкретни отколку што навистина треба да бидеме. Теоретски, ако можете да ги идентификувате „најслабите“ правила кои го прават она што го сакате, тогаш сте ја максимизирале вашата способност да се прилагодите на новите ситуации.

Што подразбираме под најслабите правила? Техничката дефиниција е комплицирана, но послабите правила обично се оние кои можат да се опишат во поедноставни изјави.

Во примерот погоре, обичен англиски израз на правилото може да биде нешто како: „Секоја форма со испакната линија ќе се премести до крајот на таа линија и ќе ги „покрие“ сите други форми со кои се преклопува“.

Синџир на мисли

Иако сè уште не знаеме како OpenAI го постигна овој резултат, се чини малку веројатно дека тие намерно го оптимизирале системот o3 за да најдат слаби правила. Меѓутоа, за да успее во задачите на ARC-AGI, мора да ги најде.

Знаеме дека OpenAI започна со општа намена на верзијата на моделот o3 (кој се разликува од повеќето други модели, бидејќи може да поминува повеќе време „размислувајќи“ за тешки прашања) и потоа го обучи специјално за тестот ARC-AGI.

Францускиот истражувач на вештачката интелигенција Франсоа Шоле, кој го дизајнираше реперот, верува дека o3 пребарува низ различни „синџири на мислата“ опишувајќи чекори за решавање на задачата. Потоа ќе го избере „најдоброто“ според некое лабаво дефинирано правило, или „хеуристичко“.

Ова не би било различно од тоа како системот AlphaGo на Гугл пребаруваше низ различни можни секвенци на потези за да го победи светскиот шампион Go.

Можете да помислите на овие синџири на размислување како програми што одговараат на примерите. Се разбира, ако е како Go-playing AI, тогаш му треба хеуристичко, или лабаво правило, за да одлучи која програма е најдобра.

Може да се генерираат илјадници различни навидум еднакво валидни програми. Таа хеуристика може да биде „избери го најслабото“ или „избери го наједноставното“.

Меѓутоа, ако е како AlphaGo, тогаш тие едноставно имаа вештачка интелигенција да создаде хеуристика. Ова беше процесот за AlphaGo. Google обучи модел да оценува различни секвенци на потези како подобри или полоши од другите.

Она што сè уште не го знаеме

Се поставува прашањето дали ова е навистина поблиску до AGI? Ако така функционира o3, тогаш основниот модел можеби нема да биде многу подобар од претходните модели.

Концептите што моделот ги учи од јазикот можеби не се посоодветни за генерализација од порано. Наместо тоа, можеби само гледаме пообопштив „синџир на мисли“ пронајден преку дополнителните чекори на обука на хеуристика специјализирана за овој тест.

Скоро сè за o3 останува непознато. OpenAI има ограничено обелоденување на неколку медиумски презентации и рано тестирање на мал број истражувачи, лаборатории и институции за безбедност на вештачката интелигенција.

Вистинското разбирање на потенцијалот на o3 ќе бара обемна работа, вклучувајќи проценки, разбирање на распределбата на неговите капацитети, колку често не успева и колку често успева.

Кога o3 конечно ќе биде објавен, ќе имаме многу подобра идеја дали е приближно приспособлив како просечен човек.

Ако е така, тоа би можело да има огромно, револуционерно, економско влијание, воведувајќи нова ера на самоподобрувачка забрзана интелигенција. Ќе бараме нови одредници за самиот AGI и сериозно размислување за тоа како треба да се управува.

Ако не, тогаш ова сепак ќе биде импресивен резултат. Сепак, секојдневието ќе остане исто.

Извор: TheConversation

Подготви: Ј. Ѓ.